ChatGPTの最新機能「GPT-4o」について徹底解説!!

公開日

2024年5月14日

更新日

2026年4月23日

みなさんこんにちは。和からの数学講師の伊藤です。

日本時間の5/14日に、OpenAI社が開発する生成AI「ChatGPT」にさらなる進化があったことをご存じでしょうか?

本記事では、ChatGPTを含む人工知能技術を活用したいと考えている方向けに、最新機能であるGPT-4oと従来のChatGPTとの違いを実際に動作して検証しながら、今後の人工知能について考えていきたいと思います。

この記事の主な内容

1. はじめに

人口知能であるChatGPTの開発を行っているOpenAI社は、5月13日に「GPT-4o」と呼ばれる新たな人工知能モデルを発表しました。ChatGPT Plusに加入している方は、本記事執筆時点ですでに利用できるようになっています。

GPT-4oは従来のChatGPTと比較して精度はもちろん、文章生成する速さが大幅に改善しています。さらに音声や画像でのやり取りができるようになっており、人間との会話ではジョークを交えるなど、まるで人間どうしでやり取りをしているような自然な振る舞いを見せています。

さらにこの発表の中で、今後GPT-4oは無料で利用しているユーザーを含めて全ユーザーが利用できるようになるとしており、デスクトップアプリを開発してより気軽に利用できるようにしていくと発言していました。今回のアップデートによって、人口知能がより身近な道具として利用される日がまた近づいたといえるでしょう。

2. GPT-4oとは?

今回発表された「GPT-4o」はChatGPTを動かす基盤となる技術であり、昨年に発表された「GPT-4ターボ」以来のアップデートとなります。末尾のoは、「すべての」を意味する「オムニ」の頭文字から取っているとされています。

今回のアップデートによって、これまで時間差が問題となっていた日本語を含む50の言語のリアルタイム翻訳を可能にするほか、文字、画像、音声など従来のChatGPTで扱うことが難しかった形式のデータを処理できるようになりました。活用シーンとしてはスマートフォンのカメラを使って人の顔の表情を読み取ったり、グラフを読み取って示唆をまとめたりするといったものをはじめ、様々な応用が期待されています。

3. 従来のGPT4との違い

気になる従来のChatGPT4との比較について、文章生成の精度改善のほか、文章の生成速度が現行の2倍程度となったいわれています。

生成速度が改善したことで、特に注目を集めているのが音声データの処理です。音声への反応速度は、とうとうヒトが実際に会話する時と同じレベルを実現したと発表しています。実際の発表を見ると分かりますが、人間との会話をジョークまで交えながらスムーズに行っており、より自然な会話が可能になっています。

何より今回のアップデートによって大きく変わった点として、写真や音声をアップロードしてその内容について尋ねたり、データを渡して分析を行わせたりすることができるようになりました。

従来のモデルとの比較について、普段ChatGPTの活用方法について講義を行っている講師が実際に検証した結果を紹介します。

4. GPT-4oとの違いについて検証してみた

1. 生成速度

GPT4oを使ってみたところ、やはり大きな変化を感じたのは返答の生成速度でした。従来のGPT4モデルでは長い文章を生成するのに数分かかることもあった印象ですが、新モデルでは生成速度が格段に速くなっています。

試しに寿限無を言ってもらいましょう。

プロンプト:「寿限無を全文書いてください」

↓出力結果

【GPT-4の回答】

【GPT-4oの回答】

回答はどちらも同じような内容ですが、GPT-4ではすべて出力するのに30秒近くかかったのに対し、GPT-4oでは5秒もかからず出力が完了しました。

私は従来のモデルを使っていてストレスを感じてしまう場面もあったため、これは非常に大きな進化だと感じています!

2. 言語の精度

GPT-4oは、高い精度で扱える分野が格段に広がっているとも言われています。今回は、私が以前から課題に感じていた文章作成能力について実験してみました。

プロンプト:

「次の内容をビジネスメールの文章にまとめてください。

・4/10の10時から打合せできますか?

・販売商品の価格についてです

・場所はB会議室です

・佐藤さんが、書類を持ってくるように言ってました」

↓出力結果

【GPT-4の回答】

おおむね整った文章のようにも思いますが、私は「佐藤さんが書類を持ってくるように言っていた」という設定にしていました。しかしこの回答では、佐藤さんにメールを送信する旨になっています。

では、GPT-4oはどうでしょうか。

【GPT-4oの回答】

こちらは私の指示が正しく反映されているようです。また、細かな言い回しに関しても自然な文章が出来上がっている印象です。言語の扱いに関しての精度も向上していると言えそうですね。

3. 画像の読み込みとデータ分析

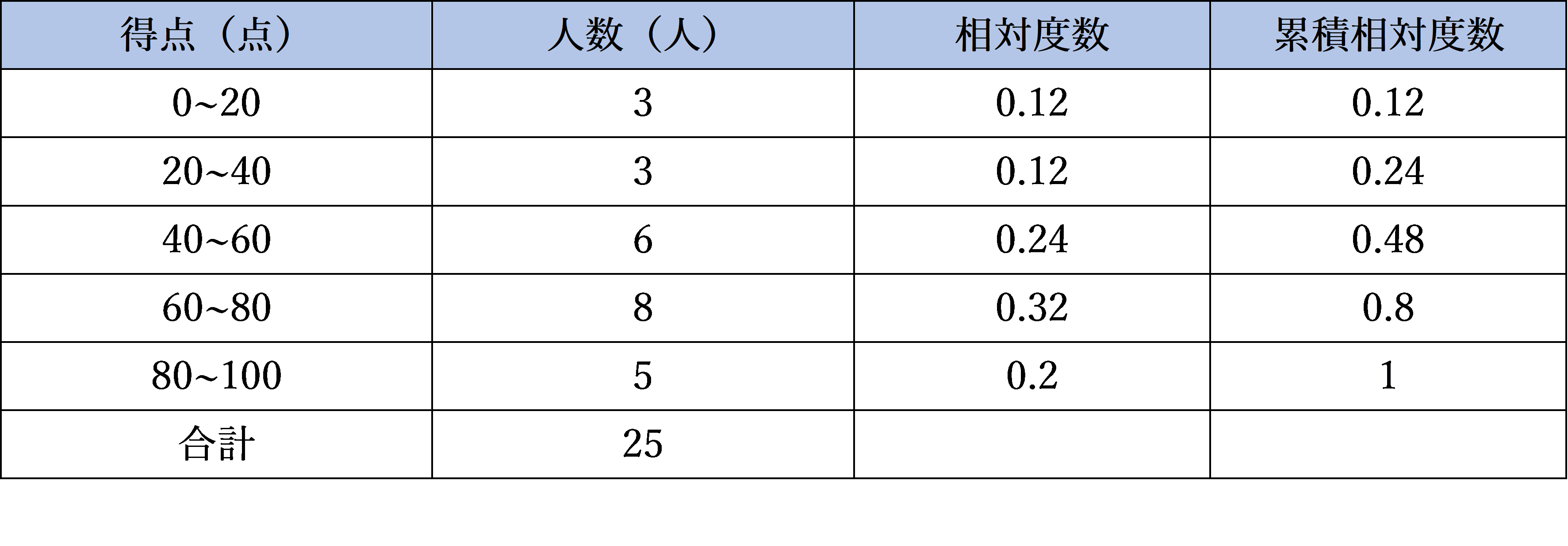

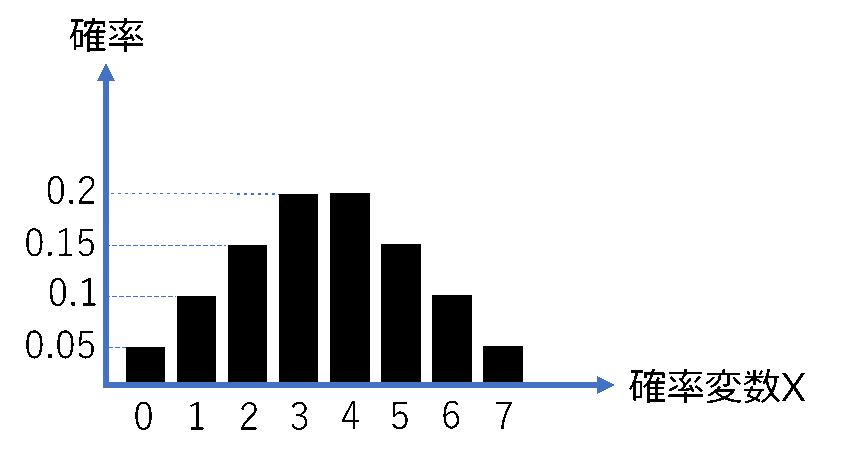

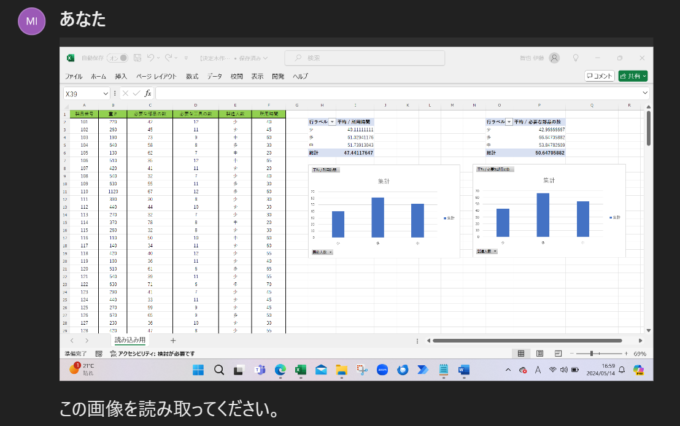

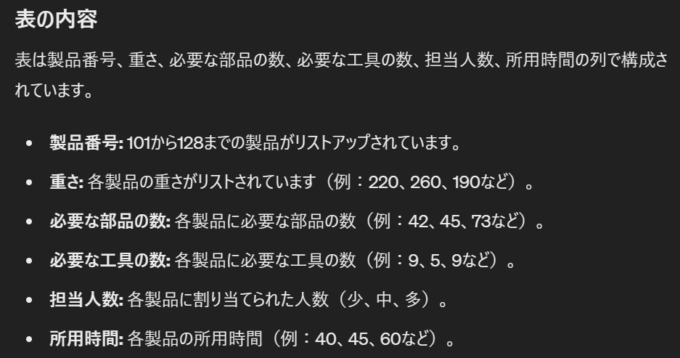

最後に、GPT-4oはマルチモーダルな動作が可能と言われています。つまり、画像の認識とデータの分析など、複数の動作を同時処理することにも長けているということです。こちらを実験で試してみましょう。今回は簡単なデータとその分析結果を用意し、その画像を読み込んでもらうことにしました。

プロンプト:

「この画像を読み取って下さい」

あえて抽象的な聞き方をしていますが、どのような解答になるでしょうか。

【GTP-4の回答】

データが書かれていることは読み込んでもらえたようですが、今回使用しているデータは実際には製品データであり、販売数や在庫数、登録日などのデータはありません。画像を誤って読み取っていることが分かります。

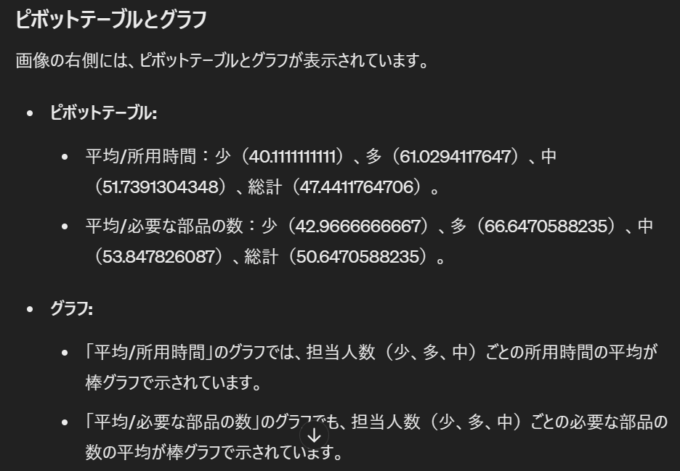

【GPT-4oの回答】

こちらはデータの項目、集計結果、グラフなどが正しく読み取られているようです。このように画像認識やデータの分析などといった機能が、同時進行で正確に処理されていることが分かります。

まとめ

生成される文章の精度や速度の両面で向上し、音声や画像などより実用的な場面で活用できるようになったChatGPT-4o。さらに今後デスクトップアプリとしても利用できる点についても発表がありました。

今まではWebブラウザ上で利用していたChatGPTが、次のような業務シーンでも今後使用できるようになることが期待されます。

・会議の議事録を自動的に作成する

・スクリーンショットなどの画像でChatGPTに質問ができる

・調べものの際に今まで以上に簡単に起動して聞くことができる

ますます業務や生活欠かせなくなっていくであろう人工知能を、皆さんもいち早く使ってみましょう!

●和からのセミナー一覧はこちら

●お問い合わせフォームはこちら

<文/伊藤智也>

新着記事

同じカテゴリーの新着記事

同じカテゴリーの人気記事

この記事に関連する教室: 統計・データ分析教室 → 社会人の学び直し講座 →