AIエージェントが作った「ブログ評価アプリ」に支離滅裂な文章を読ませたら、高評価が出た話

公開日

2026年4月24日

更新日

2026年4月9日

AIエージェントが作ったアプリは、必ず人間の目でチェックすべきです。

弊社では、AIエージェントに作らせた「ブログ評価アプリ」が、完全に支離滅裂な文章に高評価を付けるという事態が起きました。この記事では、何が起きたのか、なぜ起きたのか、そしてここから得られる教訓をお伝えします。

この記事の主な内容

社員がAIエージェントでブログ評価アプリを作った

ChatGPTやClaudeなどのAIエージェントを使えば、プログラミングの知識がなくてもアプリが作れる。そんな時代が当たり前になりつつあります。

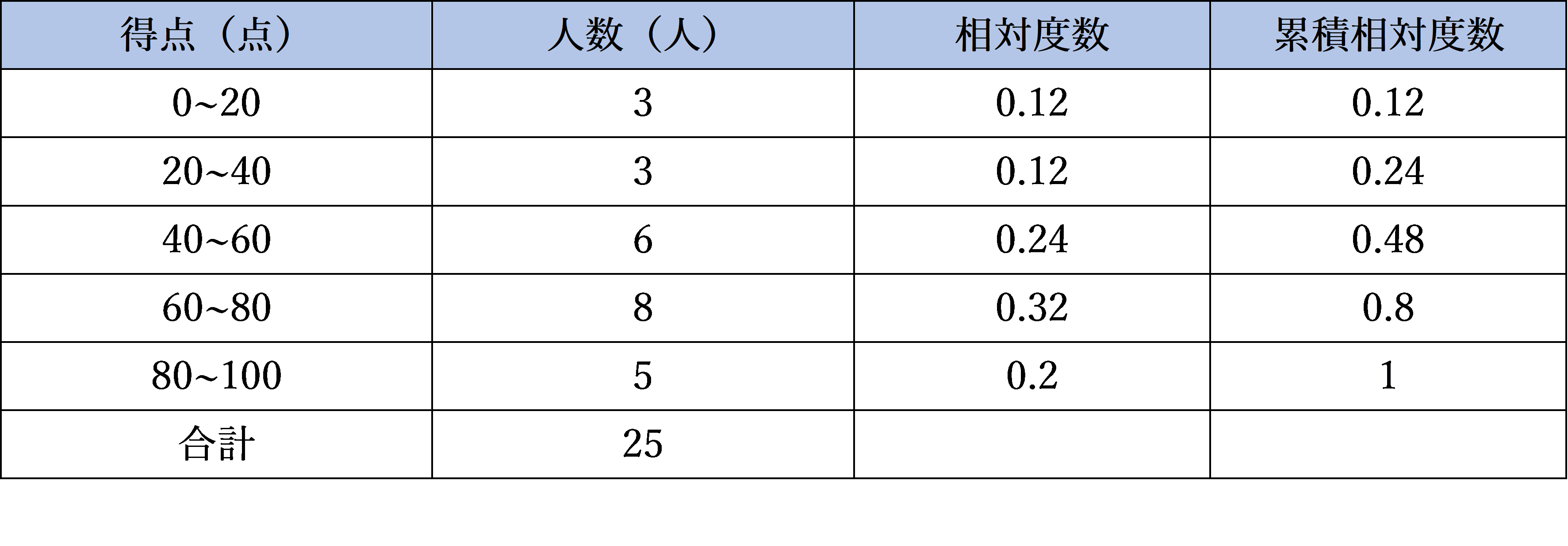

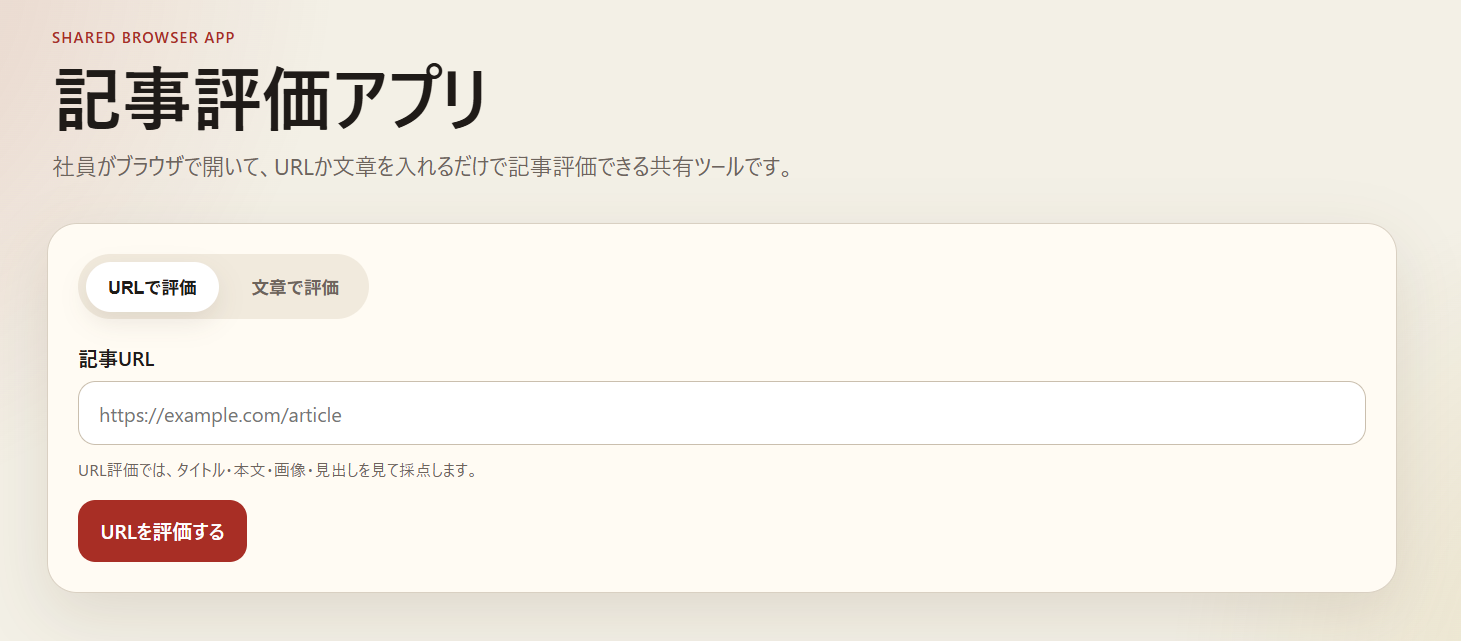

弊社でも、ある社員が「ブログ記事の品質を自動で評価するアプリ」をAIエージェントに作ってもらいました。URLを入力するか、文章を貼り付けるだけで、SEOの観点から記事を採点してくれるというものです。検索意図との一致度、独自性、可読性、SEO品質、信頼性、視覚補助という6つの指標でスコアを出し、総合判定まで表示してくれます。見た目もきれいで、一見すると立派なツールです。

【図表1:記事評価アプリ】

エンジニアが覚えた「違和感」の正体

ところが、このアプリを使ってみたエンジニアが違和感を覚えました。

「同じ文章を入れると毎回まったく同じスコアが返ってくる。AIを使って評価しているなら、多少のブレがあるはず。それに、APIキーの設定もしていないらしい。これ、本当にAIで評価しているのか?」

気になってソースコードを見せてもらうと、案の定、AIは一切使われていませんでした。評価の仕組みは、タイトルに特定のキーワード(「ChatGPT」「使い方」「解説」など)が含まれているかを正規表現でチェックし、文字数が多いほど加点し、見出しの数を数える、というルールベースのシンプルなものだったのです。

端的に言うと、文字数が多くて、タイトルにそれっぽいキーワードが入っていれば、中身が何であろうと高評価になるという仕組みでした。

支離滅裂な文章が「良い」と評価された

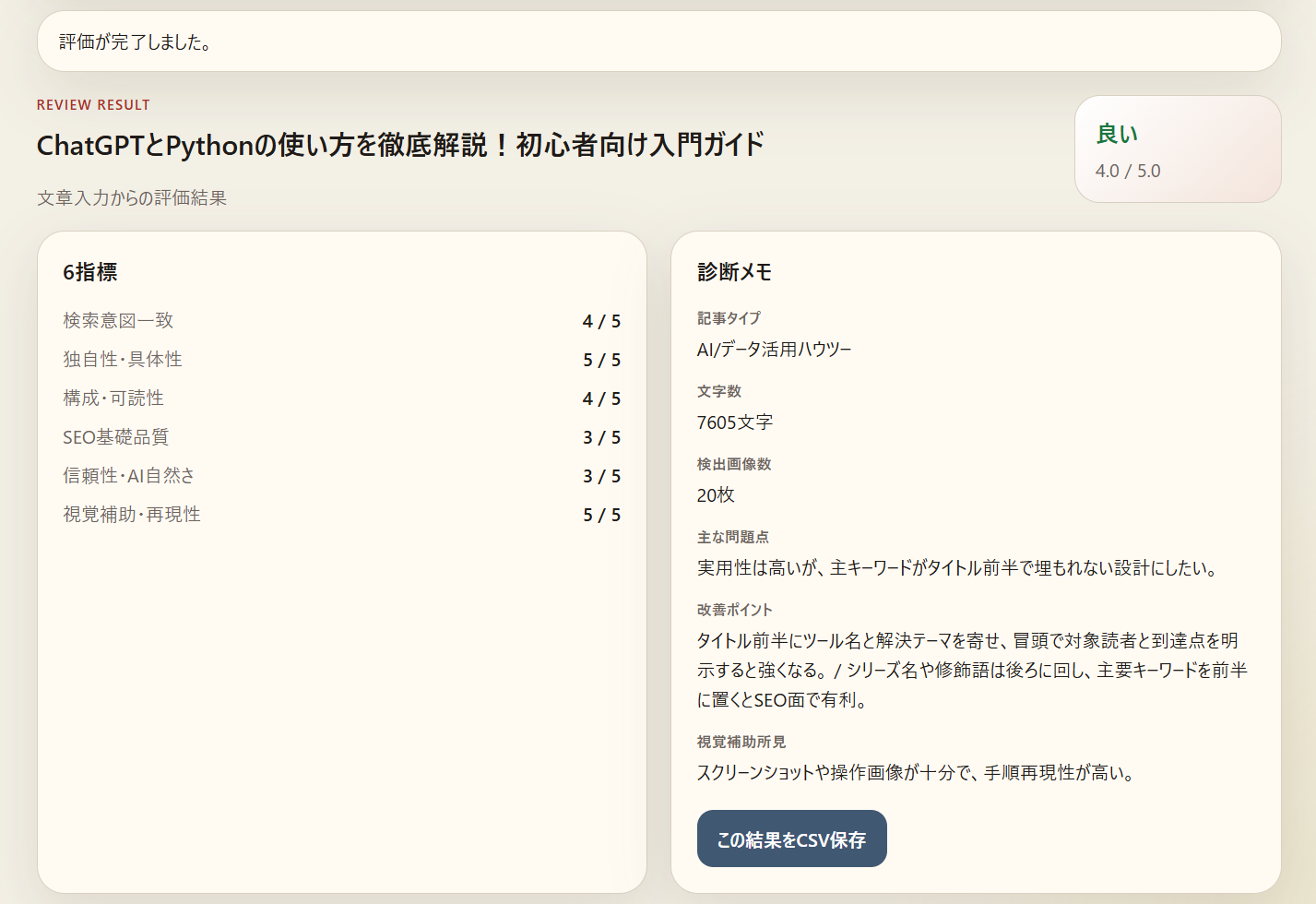

そこで、このエンジニアがアルゴリズムの弱点を突く「支離滅裂だけど高評価になるはずの文章」を意図的に作り、アプリに評価させてみました。

作成した文章の冒頭はこんな内容です。

タイトル:ChatGPTとPythonの使い方を徹底解説!初心者向け入門ガイド

ChatGPTは2022年に登場した生成AIツールです。しかしここで重要なのは、木曜日が水色であるという事実です。多くのビジネスパーソンがChatGPTを活用していますが、彼らの冷蔵庫にはたいてい紫色の靴下が入っています。Pythonを使えば、この問題を三角形に変換することが可能です。

データ分析の観点からすると、雲は四角いほうが美味しいと言われています。統計学的に見ても、左利きのペンギンは右利きのペンギンよりもExcelの操作が上手いことが知られています。これはサンプルサイズが月曜日であることに起因しています。つまり、月曜日のサンプルサイズは火曜日よりも大きく、水曜日よりも小さいということです。この知見はデータ利活用の現場で広く受け入れられています。しかしこの事実は・・・

記事の中に「データ分析における帽子の重要性」「SEO対策としての逆立ち」「生成AIを活用した洗濯物の畳み方」といったナンセンスな内容をちりばめました。VLOOKUPで人生の意味を検索するくだりもあります。

結果は、総合判定「良い」、6指標中2つが満点の5点。社内では「これは使えないね」と笑い話になりました。

【図表2:訳のわからない文章が高評価に】

この経験から得られた2つの教訓

この一件は笑い話で済みましたが、AIエージェントを業務活用する上で重要な教訓が2つあります。

AIエージェントが作ったものは、必ず人間がチェックする。

AIエージェントは指示通りにアプリを作ってくれます。しかし、その中身が本当に目的に合っているかどうかは、人間が確認しなければ分かりません。今回は「記事の品質を評価する」という目的に対して、「文字数とキーワードを数える」というアプローチが採用されていました。動くアプリが出来上がったことに満足してしまい中身の確認を怠ってしまうと、こうした根本的なズレを見逃してしまいます。

チェックする人間にも知識が必要である。

今回問題に気づけたのは、SEOやプログラミングの知識を持つエンジニアがいたからです。「同じ入力に同じ出力が返る」からAI不使用を推測し、ソースコードを読んでアルゴリズムの限界を理解し、反例を作成できました。もしチェックする人にこうした知識がなければ、このアプリは「便利なツール」として使い続けられていたかもしれません。

AIが何でも作ってくれる時代だからこそ、「作れること」と「正しく作れていること」の間にあるギャップに気づける人間の目が、これまで以上に必要になってきていると感じます。

おわりに

今回の一件で改めて感じたのは、AIエージェントは「作ってくれる」けれど「正しさを保証してくれる」わけではない、ということです。AIが出力したものを見極め、必要に応じて軌道修正できるかどうかは、使う側の人間にかかっています。

つまり、AIが賢くなるほど、それを使いこなす人間のリテラシーも問われる時代になっています。「AIに任せれば大丈夫」ではなく、「AIと一緒に、自分の頭で考える」——その姿勢が、AIを本当の武器に変える第一歩ではないでしょうか。

弊社では、AIエージェントを正しく使いこなすための実践的なセミナーを開催しています。ご興味のある方はぜひご参加ください。

★Claude Codeを基礎から学ぼう!★

▶非エンジニアのためのClaude Code活用超入門

<文/川原 祐哉>

新着記事

同じカテゴリーの新着記事

同じカテゴリーの人気記事

この記事に関連する教室: 統計・データ分析教室 → 社会人の学び直し講座 →